데이터 센터 핵심 산업 4가지

(AI 인프라의 진짜 돈 되는 영역)

AI 시대가 본격화되면서 데이터 센터는 더 이상 단순한 서버 보관 공간이 아니다.

초대형 AI 모델 학습과 실시간 추론을 가능하게 하는 핵심 인프라로 자리 잡았고, 이에 따라 데이터 센터를 둘러싼 산업 구조 역시 빠르게 분화되고 있다.

특히 최근에는 “데이터 센터 자체”보다

👉 데이터 센터를 구성하는 핵심 산업에 투자 자금이 집중되고 있다.

이 글에서는 AI 시대 데이터 센터를 지탱하는 핵심 산업 4가지를 정리하고,

왜 이 영역들이 실제로 “돈이 되는 구간”인지 살펴본다.

1️⃣ 전력 인프라 – AI 시대의 가장 큰 병목

AI 데이터 센터에서 가장 중요한 요소는 단연 전력이다.

최신 GPU는 하나만으로도 막대한 전력을 소비하며, 수천~수만 개의 GPU가 동시에 가동되는 데이터 센터는 하나의 소형 도시 수준의 전력 수요를 만들어낸다.

왜 전력이 핵심인가?

-

AI 모델 규모 확대 → GPU 사용량 폭증

-

전력 공급 불안정 = 데이터 센터 가동 중단 리스크

-

전력 비용이 곧 운영 수익성을 결정

이 때문에 최근 데이터 센터 투자는

전력 확보 → 데이터 센터 건설 순서로 진행되는 경우가 많다.

👉 AI 인프라 경쟁의 출발점은 결국 **“누가 더 안정적이고 저렴한 전력을 확보하느냐”**로 귀결된다.

전력을 얻는 방법은 단일 방식이 아닌 여러 에너지원이 함께 사용되는 영역이다. ⚡

원자력, 태양광, 수력, 화석연료, 수소 등

다양한 발전 방식이 데이터 센터 전력 공급에 활용되고 있으며,

각 에너지원의 특성에 맞춰 안정성과 효율을 동시에 확보하려는 시도가 이어지고 있다.

특히 AI 데이터 센터의 전력 수요가 급증하면서,

전력 효율을 높이고 비용을 낮추는 방식이

데이터 센터 경쟁력을 좌우하는 중요한 요소로 떠오르고 있다.

이미지 출처 : unsplash

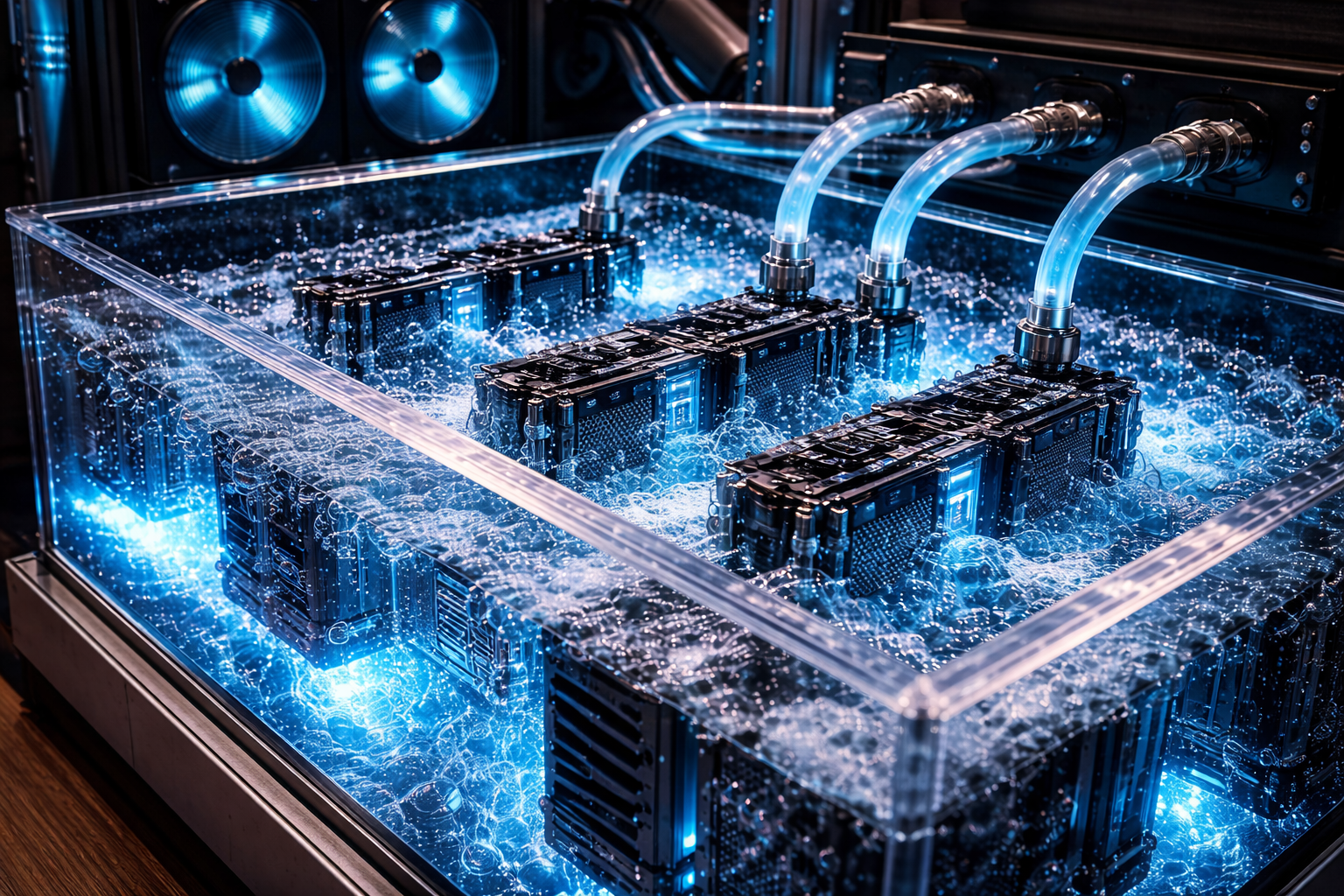

2️⃣ 냉각 인프라 – GPU가 살아남기 위한 필수 조건

AI 데이터 센터의 또 다른 핵심은 **냉각(Cooling)**이다.

고성능 GPU는 엄청난 연산 성능만큼이나 높은 발열을 동반하며, 냉각이 제대로 되지 않으면 성능 저하나 장비 손상으로 이어진다.

냉각 기술이 중요한 이유

-

공랭 방식의 한계 도달

-

수랭, 액침 냉각 등 고급 냉각 기술 확대

-

냉각 효율(PUE)이 곧 전력 효율로 연결

이 때문에 냉각은 더 이상 부가 설비가 아니라,

데이터 센터 설계의 핵심 축으로 취급되고 있으며 👉 AI 연산 성능을 좌우하는 핵심 기술로 빠르게 진화 중이다.

AI 연산 밀도가 높아질수록 발열 문제는 더 심각해지고 있으며,

이를 해결하기 위한 냉각 기술 역시 빠르게 발전하고 있다.

기존의 공랭·수랭 방식뿐 아니라

액침 냉각, 칩 레벨 냉각 등 새로운 방식들이 등장하는 단계다.

또한 극한 환경을 활용한 냉각 방식에 대한 실험도 이어지고 있어,

냉각 기술은 데이터 센터 경쟁력을 좌우하는

중요한 차별 요소로 자리 잡고 있다.

이미지 출처 : AI 생성

3️⃣ 광통신·네트워크 – AI는 연결 속도로 완성된다

AI 모델 학습은 단일 서버에서 끝나지 않는다.

수천 개의 GPU가 동시에 데이터를 주고받으며 학습을 진행하기 때문에, 초고속 네트워크가 필수적이다.

왜 광통신이 중요한가?

-

서버 간 데이터 이동 속도가 AI 성능을 좌우

-

대규모 병렬 연산에는 초저지연 네트워크 필수

-

기존 네트워크로는 AI 트래픽 감당 불가

👉 광통신과 네트워크 역시 데이터 센터에서

연산 성능만큼이나 중요한 핵심 인프라다. 🌐

AI 모델 학습과 추론 과정에서는

수천 개의 서버와 GPU가 동시에 데이터를 주고받기 때문에,

데이터 이동 속도와 지연 시간이 전체 성능을 좌우한다.

이로 인해 기존 네트워크 방식의 한계를 넘기 위한

초고속·저지연 광통신 기술에 대한 수요가 빠르게 증가하고 있으며,

네트워크 효율을 높이는 것이

AI 데이터 센터 경쟁력의 중요한 요소로 자리 잡고 있다.

이미지 출처 : unsplash

4️⃣ 반도체 – 데이터 센터의 두뇌와 신경계

데이터 센터 산업의 최종 핵심은 반도체다.

GPU, HBM 메모리, 네트워크 칩 등은 데이터 센터의 성능을 직접적으로 결정한다.

데이터 센터 반도체의 특징

-

범용 CPU → AI 특화 GPU·가속기 중심

-

메모리 대역폭(HBM)이 성능의 핵심

-

네트워크용 반도체 수요 급증

반도체는 데이터 센터의 성능을 결정짓는

가장 핵심적인 인프라다. 🧠

AI 데이터 센터에서는

범용 CPU보다 **GPU와 고대역폭 메모리(HBM)**의 중요성이 빠르게 커지고 있으며,

연산 성능뿐 아니라 데이터 처리 속도와 메모리 대역폭이

전체 시스템 효율을 좌우한다.

이 과정에서

삼성전자와 SK하이닉스는 HBM 시장의 핵심 공급자로 자리 잡았고,

마이크론 역시 HBM 분야에 본격적으로 진입하며 글로벌 경쟁 구도가 형성되고 있다.

AI 모델이 대형화될수록

데이터 센터는 더 많은 고성능 반도체를 필요로 하게 되며,

이는 반도체 산업 전반의 구조적 성장으로 이어지고 있다.

이미지 출처 : unsplash

🔎 정리 – AI 인프라는 ‘분해해서’ 봐야 돈이 보인다

AI 시대의 데이터 센터는 하나의 산업이 아니다.

전력 · 냉각 · 네트워크 · 반도체라는 4개의 핵심 축이 결합된 복합 인프라다.

그리고 실제 투자 관점에서 중요한 것은

“데이터 센터가 성장한다”는 막연한 이야기보다

👉 어느 산업이 가장 먼저, 가장 크게 수혜를 받는가다.

📌 다음 글 예고

다음 글에서는

데이터 센터 핵심 산업 중에서도 실제로 수익이 집중되는 영역을 더 깊게 파고들 예정이다.

-

전력 중심 데이터 센터 인프라

-

냉각 중심 데이터 센터 인프라

-

광통신 중심 데이터 센터 인프라

-

반도체 중심 데이터 센터 인프라

각 산업별로

어떤 기업이 핵심 플레이어인지,

그리고 왜 시장의 자금이 그 기업들로 몰리는지를 하나씩 정리해 보겠다.

📌 AI 반도체와 데이터 센터 인프라는 서로 분리된 개념이 아닙니다.

산업 구조와 흐름이 궁금하다면 아래 글들을 함께 읽어보세요.